多模態(tài)圖像融合旨在將來自不同成像模態(tài)的互補(bǔ)信息整合為一幅綜合圖像,以實(shí)現(xiàn)更全面的場景感知與分析。紅外圖像擅長捕捉熱輻射信息,能夠在低光照條件下揭示被遮擋的目標(biāo)細(xì)節(jié);可見光圖像則提供高分辨率的顏色和紋理信息,但在弱光或遮擋環(huán)境下獲取信息的能力有限。因此,將兩種模態(tài)的互補(bǔ)優(yōu)勢進(jìn)行有效融合,對于安防監(jiān)控、自動(dòng)駕駛、遙感觀測等實(shí)際應(yīng)用具有重要意義。然而,傳統(tǒng)深度學(xué)習(xí)融合方法高度依賴大量標(biāo)注數(shù)據(jù)進(jìn)行訓(xùn)練,難以泛化到新場景和新模態(tài);同時(shí),標(biāo)準(zhǔn)自注意力機(jī)制的二次計(jì)算復(fù)雜度也限制了其在高分辨率圖像上的實(shí)時(shí)應(yīng)用能力。

近日,信息學(xué)院(人工智能學(xué)院)許福教授團(tuán)隊(duì)在IEEE Transactions on Circuits and Systems for Video Technology(中科院一區(qū)Top, IF:11.1)發(fā)表了題為“FPZNet: Fuzzy Perception Zero-Shot Learning for Infrared and Visible Image Fusion”的研究論文,受人類模糊感知決策能力的啟發(fā),提出了一種基于Transformer架構(gòu)的零樣本多模態(tài)圖像融合網(wǎng)絡(luò),通過稀疏注意力和低秩近似機(jī)制,在無需任何預(yù)訓(xùn)練數(shù)據(jù)的條件下實(shí)現(xiàn)了高質(zhì)量的紅外與可見光圖像融合。

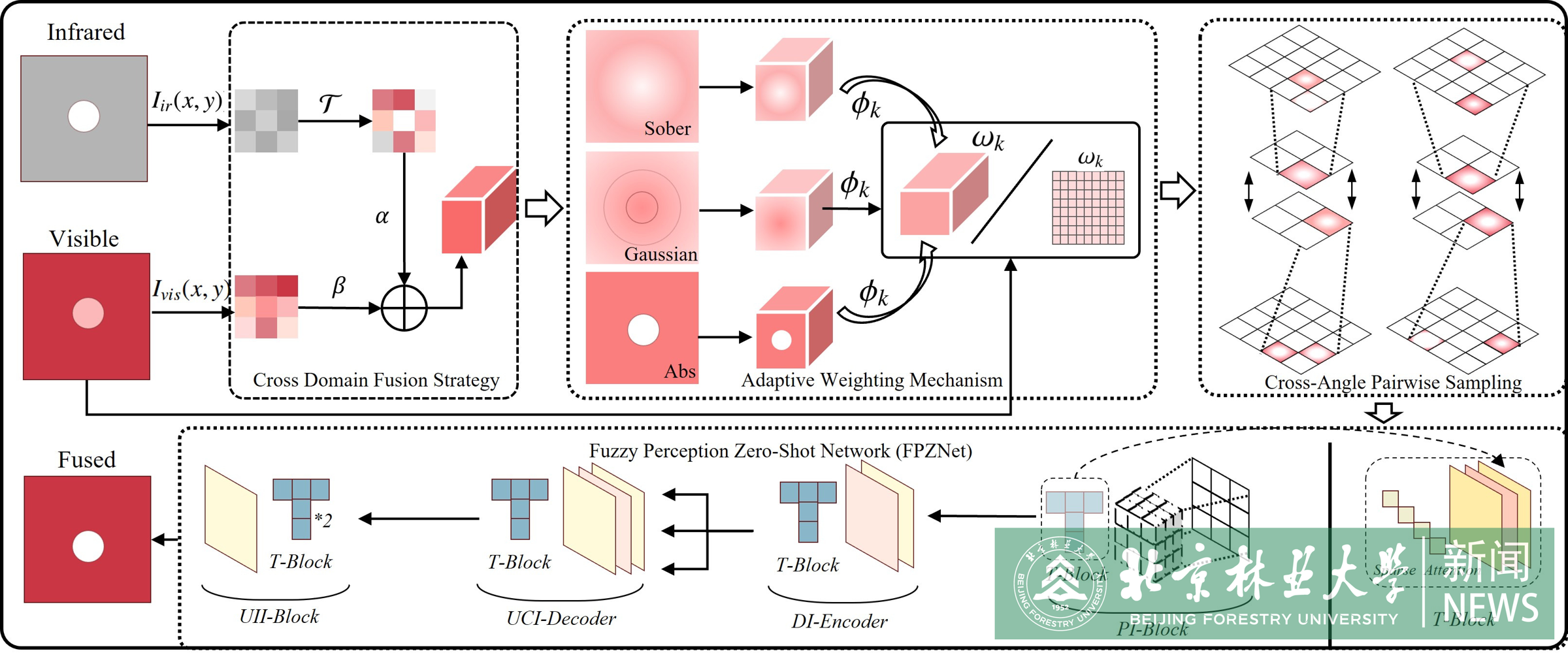

研究團(tuán)隊(duì)提出了模糊感知零樣本網(wǎng)絡(luò)(Fuzzy Perception Zero-Shot Network, FPZNet),其核心設(shè)計(jì)模仿了人類視覺系統(tǒng)在復(fù)雜不確定環(huán)境中進(jìn)行近似決策的能力。整體框架包含跨域融合策略、自適應(yīng)加權(quán)機(jī)制、交叉角度成對采樣以及基于3D Transformer的融合網(wǎng)絡(luò)四個(gè)關(guān)鍵模塊,實(shí)現(xiàn)了從數(shù)據(jù)預(yù)處理到圖像融合的全流程處理。

圖 1 FPZNet方法整體框架圖

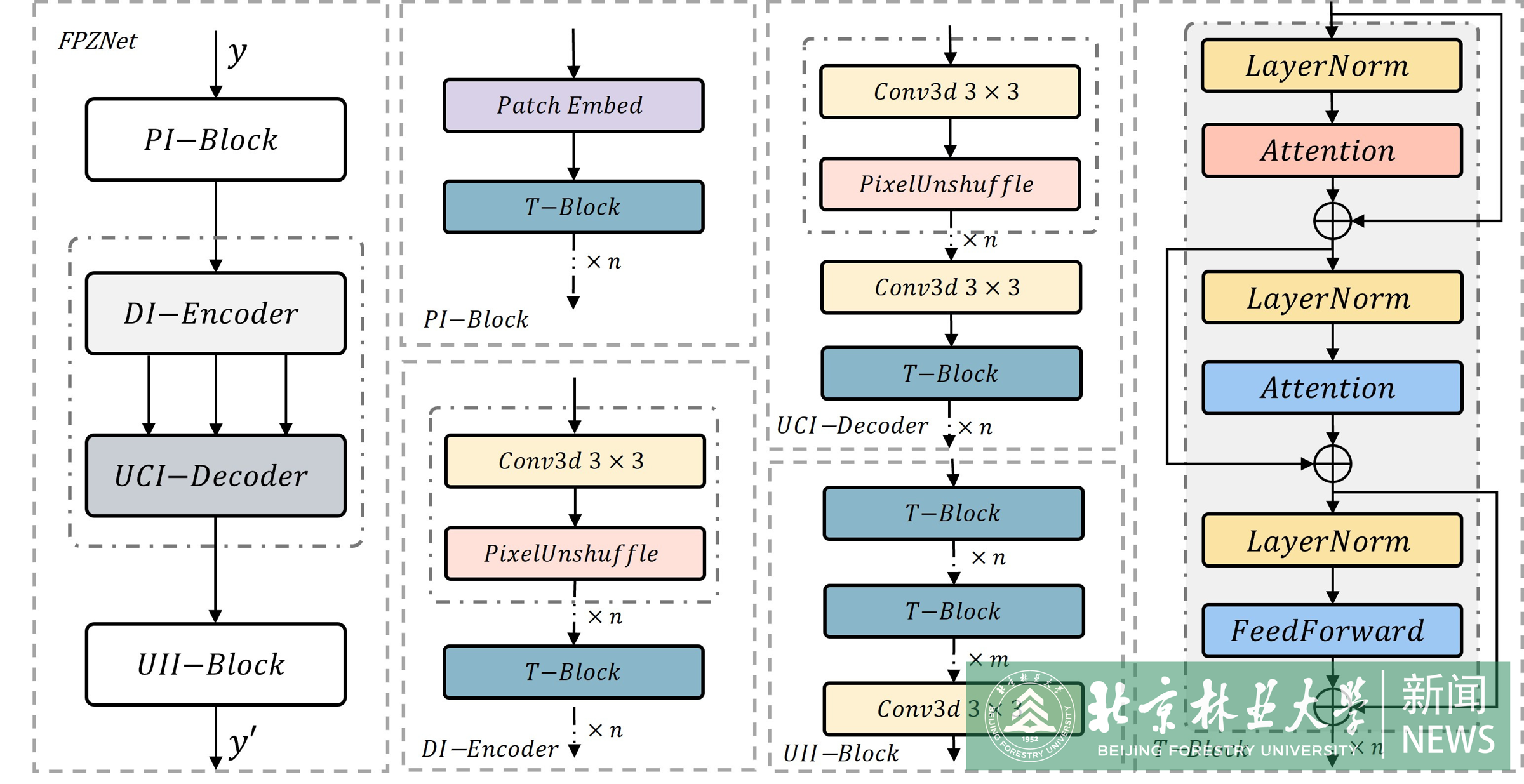

在網(wǎng)絡(luò)架構(gòu)設(shè)計(jì)上,F(xiàn)PZNet采用了由統(tǒng)一信息模塊(UII-Block)、雙交互編碼器(DI-Encoder)和統(tǒng)一交叉交互解碼器(UCI-Decoder)組成的3D Transformer結(jié)構(gòu),能夠有效捕捉輸入數(shù)據(jù)的體積依賴關(guān)系,確保跨模態(tài)特征的魯棒整合。為提升特征區(qū)分性并抑制無關(guān)跨模態(tài)連接產(chǎn)生的噪聲,研究團(tuán)隊(duì)引入了稀疏性約束,使網(wǎng)絡(luò)僅選擇性地保留15%–20%最顯著的跨模態(tài)交互,有效過濾冗余信息。同時(shí),通過低秩近似技術(shù)將注意力機(jī)制的計(jì)算復(fù)雜度從二次降低至線性,僅使用128維的投影維度即可捕獲超過95%的跨模態(tài)信息,在保證融合質(zhì)量的前提下大幅提升了計(jì)算效率。

圖 2 FPZNet網(wǎng)絡(luò)架構(gòu)圖

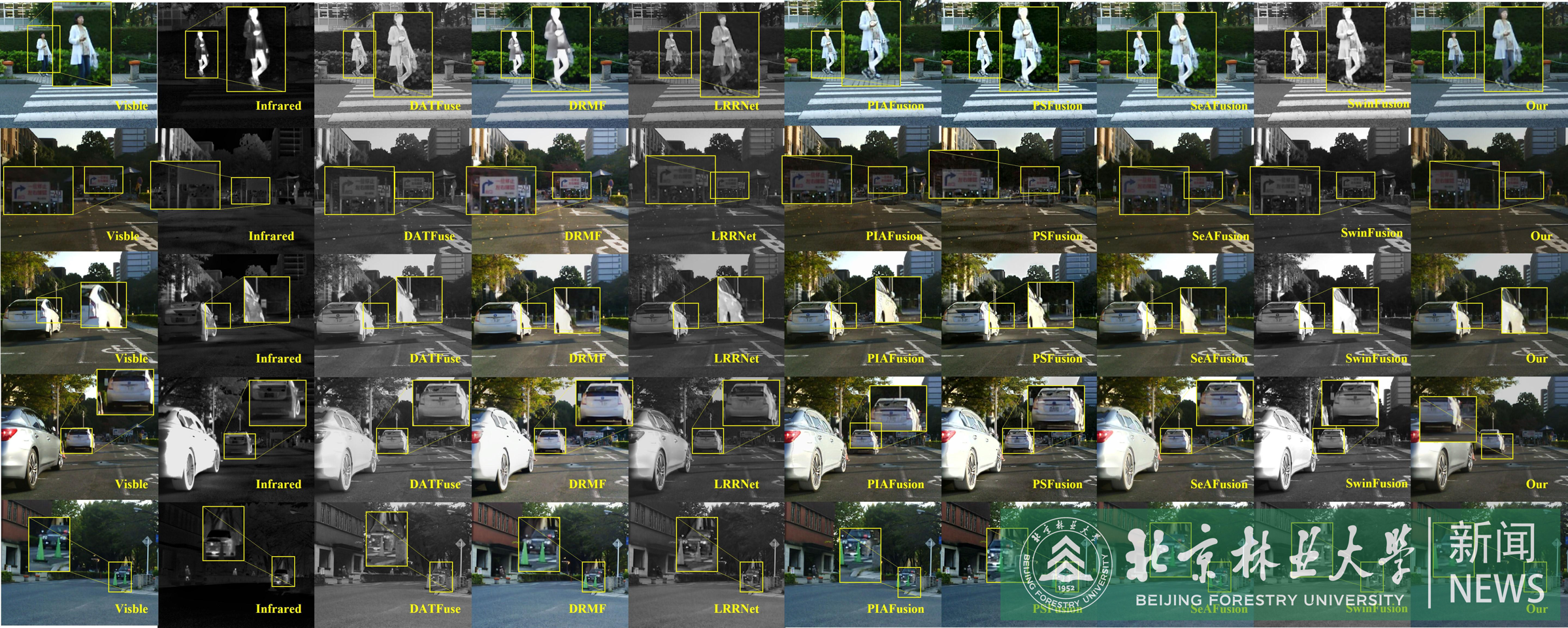

研究團(tuán)隊(duì)在RoadScene、MSRS、LLVIP等多個(gè)公開基準(zhǔn)數(shù)據(jù)集上與多種先進(jìn)融合方法進(jìn)行了全面對比實(shí)驗(yàn)。結(jié)果表明,F(xiàn)PZNet在多個(gè)數(shù)據(jù)集上均取得了優(yōu)異表現(xiàn):在MSRS數(shù)據(jù)集上實(shí)現(xiàn)了65.904 dB的峰值信噪比和0.026的最低均方誤差,分別較現(xiàn)有最優(yōu)方法提升了2.182 dB和顯著降低了信息損失。在LLVIP數(shù)據(jù)集的夜間監(jiān)控等具有挑戰(zhàn)性的低光照場景中,該方法在保持紅外熱特征的同時(shí)有效維持了自然光照梯度,展現(xiàn)出優(yōu)越的融合魯棒性。

圖 3夜間監(jiān)控場景下不同融合方法的效果對比

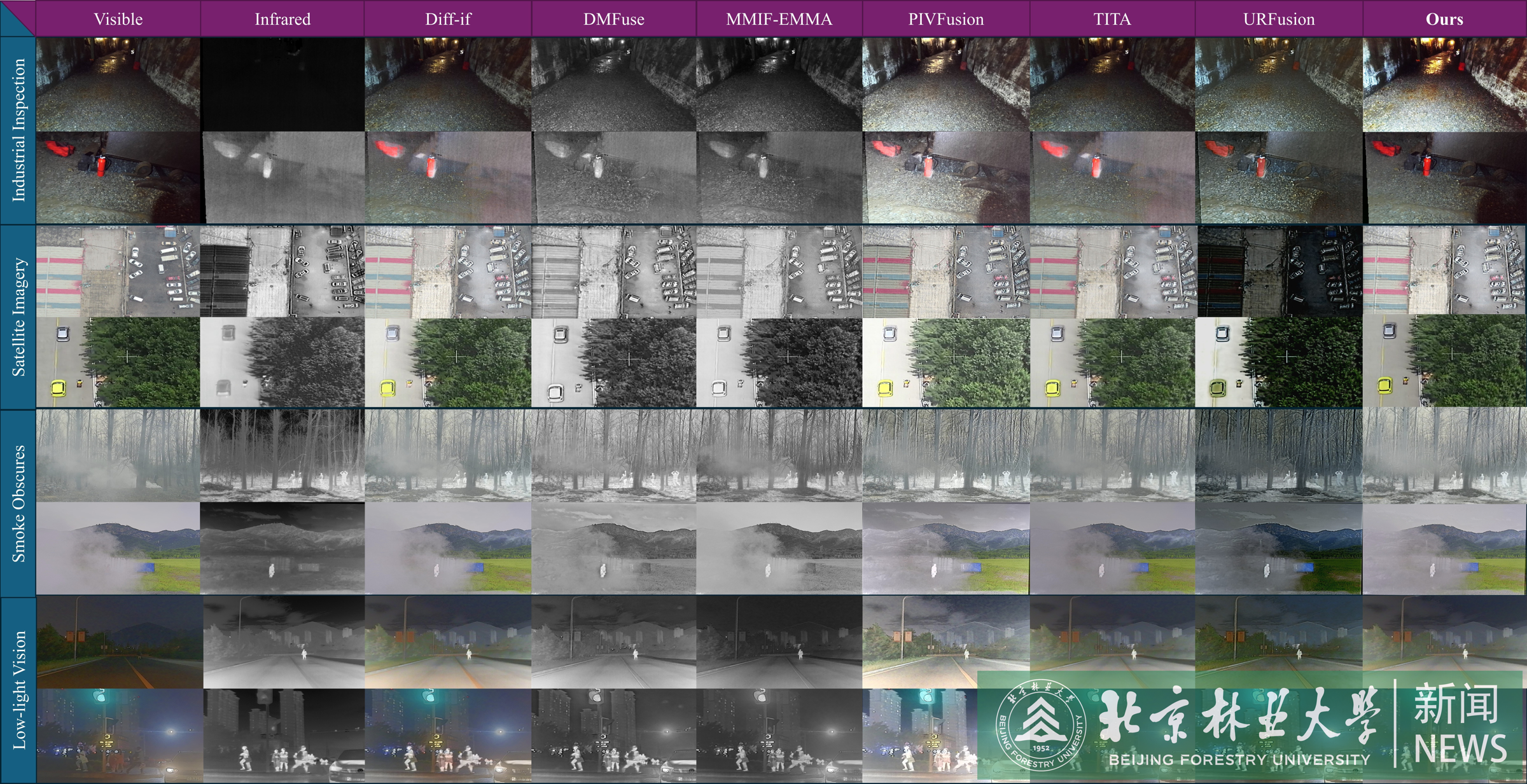

此外,研究團(tuán)隊(duì)還在涵蓋工業(yè)熱成像、煙霧退化、航空視角、自動(dòng)駕駛等8個(gè)基準(zhǔn)數(shù)據(jù)集上進(jìn)行了廣泛的跨域遷移實(shí)驗(yàn),評估了方法的泛化能力。結(jié)果顯示,F(xiàn)PZNet在56個(gè)評測指標(biāo)中有43個(gè)取得最佳性能。在下游任務(wù)驗(yàn)證中,基于FPZNet融合圖像的YOLOv8目標(biāo)檢測在LLVIP數(shù)據(jù)集上mAP@0.5達(dá)到89.7%,較次優(yōu)方法提升2.1%;DeepLabV3+語義分割在MFNet數(shù)據(jù)集上mIoU達(dá)到58.9%,較僅使用可見光圖像提升10.7%,驗(yàn)證了融合圖像對實(shí)際視覺任務(wù)的顯著增益。

圖 4 跨域遷移評估框架總覽圖

上述研究提出了一種模仿人類模糊感知決策的零樣本紅外與可見光圖像融合方法,無需特定數(shù)據(jù)集的預(yù)訓(xùn)練即可實(shí)現(xiàn)高質(zhì)量融合。該方法通過稀疏注意力和低秩近似大幅降低了計(jì)算開銷,為數(shù)據(jù)匱乏和資源受限環(huán)境下的多模態(tài)圖像融合提供了一種高效、可泛化的解決方案。

信息學(xué)院(人工智能學(xué)院)的王升老師、2023級博士生韓柏迅、楊林哲和2024級碩士陳可心為論文共同一作, 通訊作者為許福教授和孫國棟副教授,該研究受到國家重點(diǎn)研發(fā)計(jì)劃項(xiàng)目(2022YFF1302700)、國家林草局揭榜掛帥項(xiàng)目(202303)、中央高校優(yōu)秀青年團(tuán)隊(duì)項(xiàng)目(QNTD202308)的資助。